(圖片來源/The New York Times)

(圖片來源/The New York Times)

根據外媒《Slash Gear》報導,Instagram 近年在敏感圖片防範方面表現不佳。防範青少年因瀏覽自殘相關圖片,引起不當行為,IG 特別針對「敏感圖片」有隱藏機制,讓用戶自行排除動態牆上的自殘、血腥等內容。然而,此作法仍無法有效遏,因此 Instagram 未來修改圖片限制,直接遮蔽這些不當圖片。

2017年因疑似閱覽大量 Instagram 上的自殘圖片而導致自殺的英國少女莫莉羅素(Molly Russell)。(圖片來源/擷取自 The Guardian)

2017年因疑似閱覽大量 Instagram 上的自殘圖片而導致自殺的英國少女莫莉羅素(Molly Russell)。(圖片來源/擷取自 The Guardian)

2017 年,IG 被指控促成一名英國年僅 14 歲的少女莫莉羅素(Molly Russell)自殺。羅素的父親在其 IG 帳號發現,女兒生前曾經瀏覽大量的自殘、教唆自殺等敏感內容,因而認為 IG 與女兒的死有所關聯。

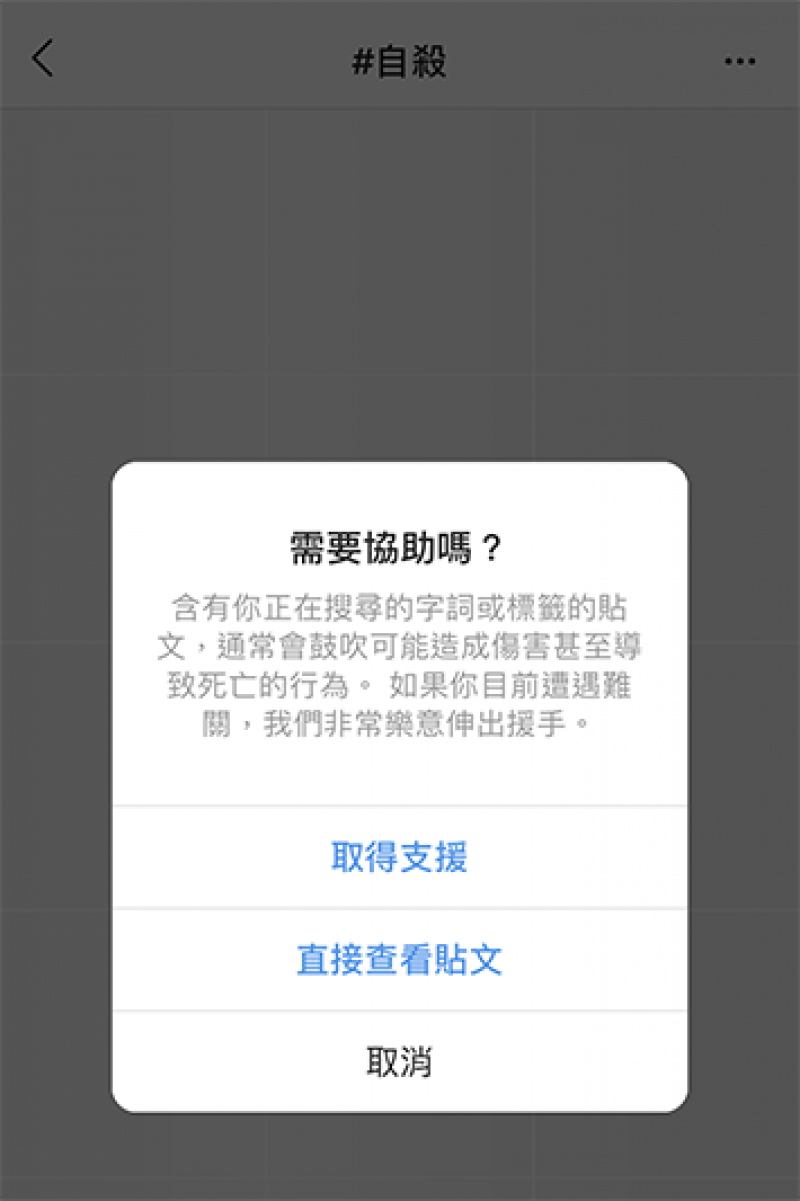

如果搜尋「自殘」、「自殺」等敏感字眼,Instagram 會跳出協助視窗。(圖片來源/擷取自 Instagram)

如果搜尋「自殘」、「自殺」等敏感字眼,Instagram 會跳出協助視窗。(圖片來源/擷取自 Instagram)

IG 遭控訴後,隨即推出隱藏圖片機制,讓用戶能自行隱藏這些不舒服的內容,或是當用戶搜尋類似「自殘」、「自殺」等關鍵字時,提供更多協助的按鍵,但實施至今成效不佳。因此現在 IG 打算直接封殺這類的敏感內容,禁止上傳自殘或自殺等圖片,無論用戶只是單純宣洩情緒或是有意誘導他人。

【你可能還想看】

網友抱怨「史上最難用!」官方緊急收回 Instagram 全新瀏覽介面

免費訂閱《自由體育》電子報熱門賽事、球星動態不漏接