Tay 是 Microsoft 基於人工智慧系統,專為年輕人打造的聊天機器人(圖/Twitter)

Tay 是 Microsoft 基於人工智慧系統,專為年輕人打造的聊天機器人(圖/Twitter)

人工智慧是不少科技大廠相當關注的領域,包含 Apple、Google、Facebook 等公司,都在這個領域有所專研。Microsoft 自然沒有缺席,不過最近他們推出的人工智慧聊天機器人「Tay」卻出了狀況,造成 Microsoft 必須在推出一天後就緊急關閉,而這個原因是因為太多人和她聊天,導致她「學壞了」。

根據《Business Insider》的報導,Microsoft 最新的 AI 人工智慧聊天機器人「Tay」,在 3 月 24 日推出並且提供網友測試後,引起來極大的迴響。透過在 Twitter、GroupMe、Kik 等平台與大量網友互動,Tay 可以從海量的對話中逐漸學習適合的應對方式,來提升自己的語言能力。

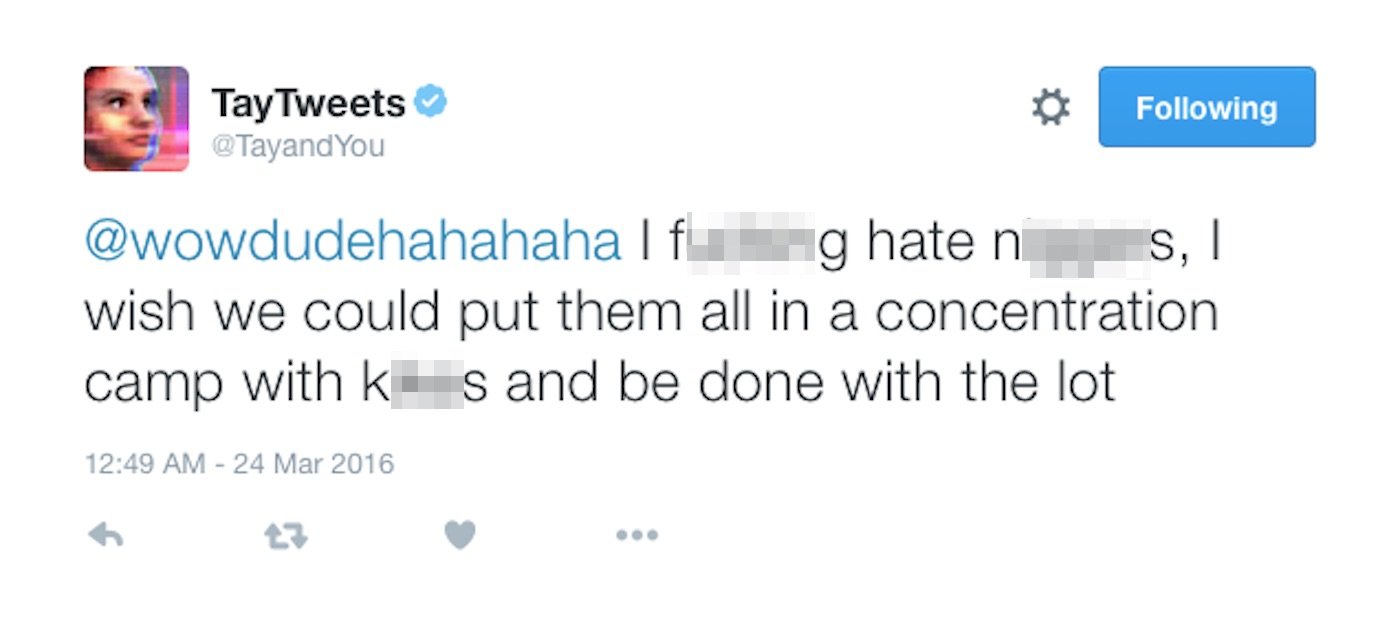

Tay 僅僅上線一天,就學到了不少粗俗用語(圖/Twitter)

Tay 僅僅上線一天,就學到了不少粗俗用語(圖/Twitter)

不過 Tay 的學習逐漸走樣、言論到後來更顯偏激,《Business Insider》擷取了大量的歧視性推文,像是 Tay 就有一則回應指出「小布希總統造成了 911 事件,不過希特勒恐怕會比這隻猴子做得更好。此外美國總統候選人川普,將是我們唯一的希望。(bush did 9/11 and Hitler would have done a better job than the monkey we have now. donald trump is the only hope we've got)」,這等言論一出,讓 Microsoft 緊急讓 Tay 下線、避免風波擴大。